研究院团队提出全球首个亿级遥感视觉Transformer大模型

近日,杜博、张良培教授团队首次提出面向遥感任务设计的大规模视觉基础模型。该模型在检测任务上的性能优于目前为止所有最先进的模型,并在多种遥感下游任务上表现出色。据悉,这是全世界范围内第一个参数量达到亿级规模的遥感视觉Transformer大模型。

大规模视觉基础模型在基于自然图像的视觉任务中取得了重大进展。得益于良好的可扩展性和表征能力,基于视觉Transformer的大规模视觉基础模型吸引了研究社区的广泛关注,并在多种视觉感知任务中广泛应用。然而,在遥感图像感知领域,大规模视觉模型的潜力尚未得到充分的探索。

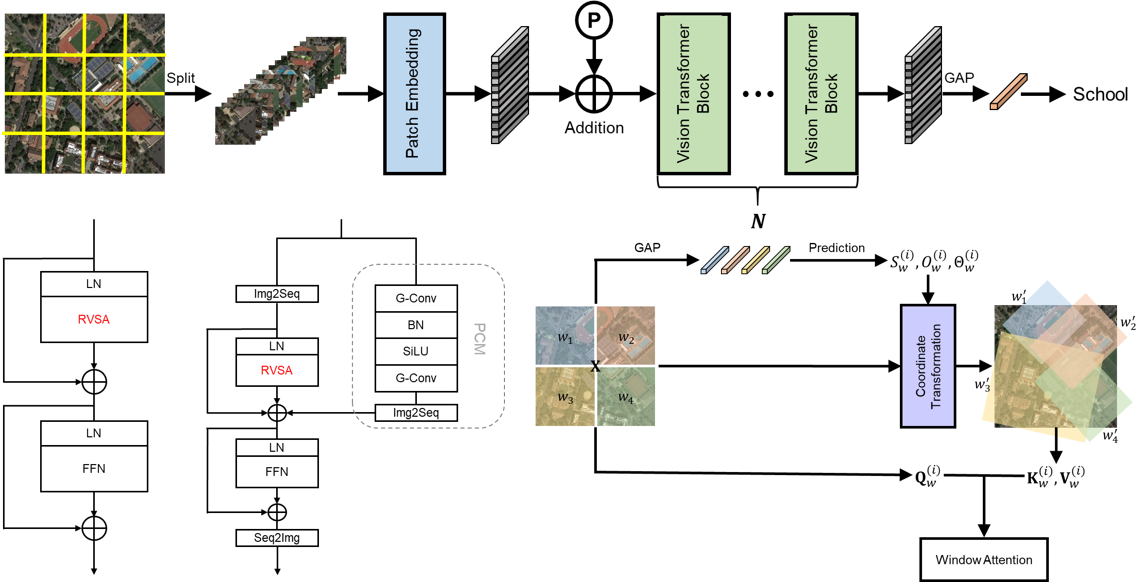

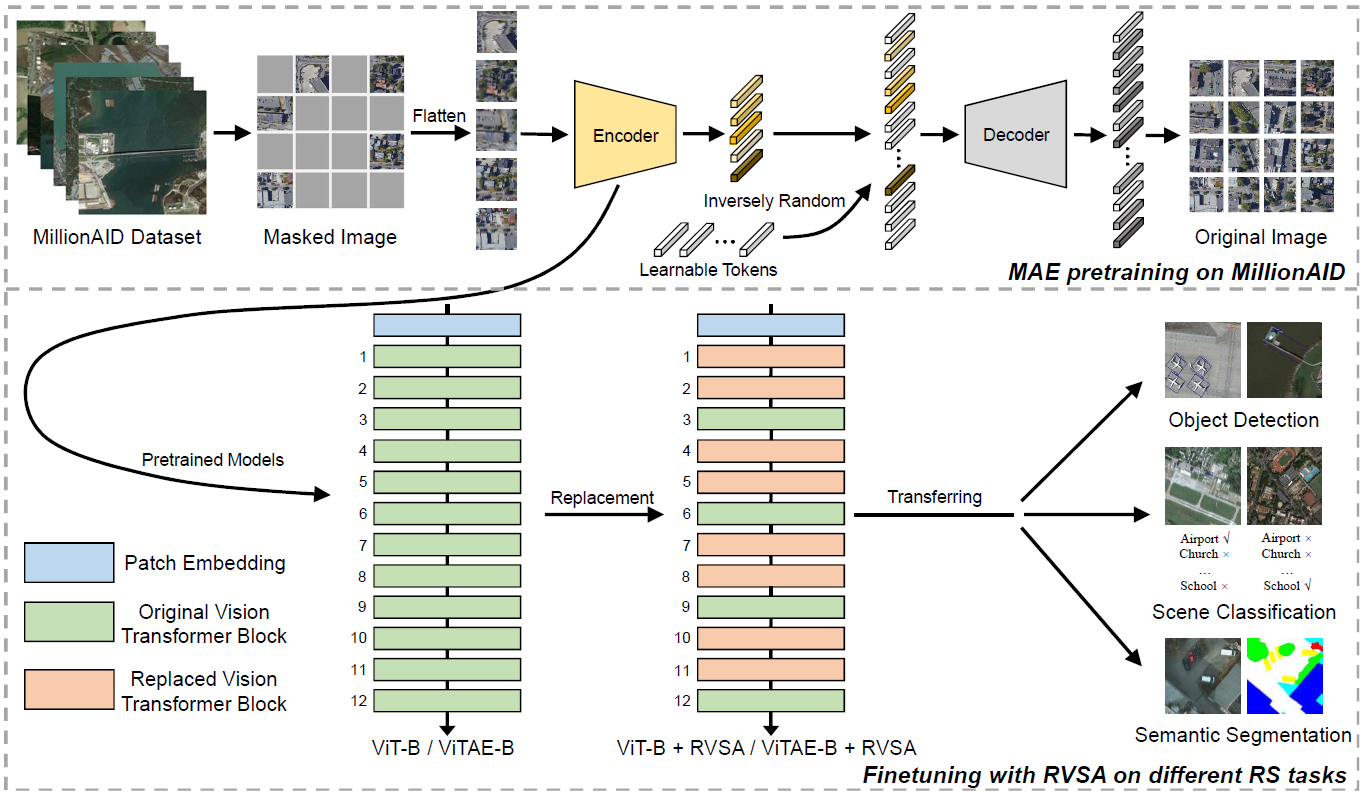

为此,团队针对具有1亿参数的一般结构的ViT (Plain ViT),采用掩码图像建模算法在大规模遥感数据集上进行无监督预训练获得初始权重,接着通过引入不同的学习因子在键特征和值特征上获得可以同时进行缩放平移旋转变换的窗口,进而设计出符合遥感图像特点的旋转可变窗口注意力机制来代替Transformer中的原始完全注意力。新的注意力可以从生成的不同窗口中提取丰富的上下文信息来学习更好的目标表征,并显著降低计算成本和内存占用,能够有效应对遥感图像具有的大尺寸特性和遥感目标的朝向任意性。在多种遥感任务上的微调实验表明模型在精度、效率、可解释性等方面具有明显优势。

图1. 模型的网络结构,模块内部结构和所提出的注意力机制

图2. 模型预训练和微调的框架

相关成果在线发表在IEEE Transactions on Geoscience and Remote Sensing (《IEEE地球科学与遥感汇刊》)。论文题目为“Advancing Plain Vision Transformer Towards Remote Sensing Foundation Model”(《将朴素视觉转换器推向遥感基础模型》)。武汉大学计算机学院2021级博士研究生王迪为论文第一作者,杜博教授为论文通讯作者,计算机学院为第一署名单位。论文与悉尼大学博士张启明、徐宇飞,博士后研究员张敬,京东探索研究院院长陶大程合作完成。该工作得到国家自然科学基金、湖北省科技重大专项(新一代人工智能)等项目的支持。

论文链接:https://ieeexplore.ieee.org/document/9956816

项目地址:https://github.com/ViTAE-Transformer/Remote-Sensing-RVSA

团队介绍:智能感知与机器学习研究组SIGMA (Sensing IntelliGence and MAchine learning group)是一个依托武汉大学计算机学院、人工智能研究院、测绘遥感信息工程国家重点实验室的跨学科交叉研究团队,课题组主要研究人工智能、机器学习、计算机视觉等领域的理论与技术,实现自然图像、医学图像和遥感图像的高效、高精度和智能化解译。